自2022年11月ChatGPT发布以来,AI经历了几十年来最大的一场热潮。一年半以后,越来越多的迹象表明这场狂欢似乎已经越过了期望之峰,即将滑向失望之谷。

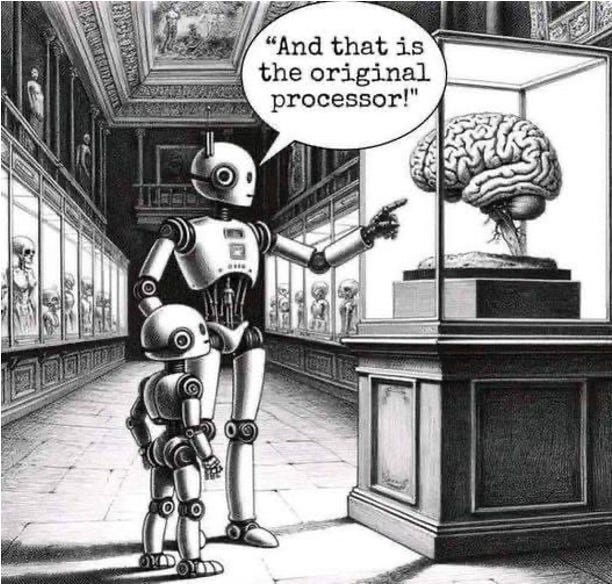

比起AI的短期发展路径,人们对其终局的争论更加激烈。一派极端认为碳基生命只是硅基生命的启动器,AI发展到最后的AGI,甚至ASI,就是造神。另一派认为,就像几年前说“数据是新石油”一样,AI是新电!它会在各个领域各个方向增强人类社会的能力,成为人类百万年来最趁手、最强大的工具,但依旧是工具,和百万年前打制的石器并无本质不同。

讨论概念很容易走上形而上的路,AI的基础仍然是技术,接下来我们从技术角度探讨这个问题。以下是GPT-4总结的AI发展历程:

1. 起步阶段(1950s-1960s)

初期发展:人工智能领域的研究始于1950年代,标志性事件是Alan Turing提出的“图灵测试”和1956年达特茅斯会议(Dartmouth Conference)。这期间,研究者们希望通过符号处理来实现智能。

早期成就:此阶段的主要成就包括初步的自动推理、求解数学问题和象棋程序。

2. 第一场AI寒冬(1970s)

背景:20世纪70年代初期,人工智能遇到了技术和资金上的双重困难。由于早期AI系统在处理复杂问题上表现不佳,加上对计算资源的需求高昂,导致研究进展缓慢。

结果:许多项目被取消,资金投入锐减,这段时期被称为“AI寒冬”。

3. 符号主义和专家系统(1980s)

专家系统:20世纪80年代,人工智能研究的重点转向专家系统,这些系统在特定领域显示出了优越的性能。

商业应用:一些成功的商业应用(如医疗诊断系统)增加了对AI的投资和兴趣。

4. 第二场AI寒冬(1980s末-1990s初)

背景:尽管专家系统在某些领域取得了成功,但其开发和维护成本高昂,适应新领域的能力有限。市场和学术界对AI的过高期望未能实现,再次导致投资减少和研究热情下降。

结果:AI研究再次进入低谷,这段时期被称为第二场“AI寒冬”。

5. 机器学习和神经网络复兴(1990s-2000s)

神经网络复兴:20世纪90年代,随着计算能力的提升和新的算法(如反向传播算法)的发展,神经网络研究重新受到关注。

数据驱动的AI:大数据和计算能力的提升推动了机器学习和数据驱动方法的发展,AI开始在图像识别、语音识别等领域取得实际应用成果。

6. 深度学习的兴起(2010s-至今)

深度学习:2010年代,深度学习模型(如卷积神经网络和循环神经网络)在处理图像、语音和自然语言任务上取得了巨大成功。

广泛应用:AI技术被广泛应用于自动驾驶、医疗诊断、金融分析等领域。以AlphaGo击败世界围棋冠军李世石为标志性事件,AI在复杂任务中的能力被广泛认可。

可以看到,AI的发展历史几乎与计算机一样悠久。在思考设计计算机的架构时,先贤们就期待有一天计算机能和人类一样聪明。

在前几十年,AI的路线基本是符号处理和专家系统,虽然在某些领域取得了一些进展,例如IBM的Deep Blue在1997年击败了国际象棋世界冠军卡斯帕罗夫,十几年后其Watson超级计算机在2011年击败了《Jeopardy!》的两位冠军。但整体而言进展始终不及预期,直到机器学习领域出现重大进展。

机器学习相关的理论提出也很早,但随着计算能力的提升和新算法的出现,在21世纪,特别是深度学习兴起后,成为AI技术的主流。

GOFAI: 老派 AI

计算机代码是决定性的,代码逻辑写好后,程序运行1万次,每次都会给出同样的结果,计算机非常擅长推理,“男人都有喉结”,因为“关羽是男人”,所以“关羽有喉结”。当用这种Symbol-manipulation符号操作的方式来实现AI时,因为corner case太多,用再多的if-else也难以穷举,最后进入死胡同。

机器学习

机器学习是一门开发算法和统计模型的科学,计算机系统利用这些算法和统计模型来执行任务,而无需明确的指令,而是依靠模式和推理。计算机系统使用机器学习算法来处理大量历史数据并识别数据模式,使它们能够从给定的输入数据集更准确地预测结果。

机器学习背后的核心思想是任何输入和输出数据组合之间存在数学关系。机器学习模型事先并不知道这种关系,但如果给定足够的数据集,它可以猜测。这意味着每个机器学习算法都是围绕可修改的数学函数构建的。基本原理可以这样理解:

我们通过提供以下输入/输出(i,o)组合来“训练”算法 - (2,10)、(5,19) 和 (9,31)。该算法计算输入和输出之间的关系为:o=3*i+4。然后我们给它输入7,并让它预测输出。它可以自动确定输出为25。

虽然这是基本理解,但机器学习关注的原则是,只要计算机系统拥有足够的数据和处理数据的计算能力,所有复杂的数据点都可以在数学上联系起来。因此,输出的准确性与给定输入的大小直接相关。

如果系统的输出是可预测的,则称其为确定性的。大多数软件应用程序对用户的操作做出可预测的响应,因此您可以说:“如果用户这样做,他就会得到那个。”但是,机器学习算法通过观察和经验进行学习。因此,它们本质上是概率性的。现在该语句变为:“如果用户这样做,则发生这种情况的概率为X%。”

深度学习

深度学习是机器学习的一个子集。深度学习算法可以看作是机器学习算法的复杂演化,在数学上也十分复杂。

深度学习算法使用与人类相似的逻辑结构来分析数据。深度学习使用称为人工神经网络的智能系统来分层处理信息。数据从输入层流经多个“深层”隐藏神经网络层,然后到达输出层。额外的隐藏层支持比标准机器学习模型更强大的学习能力。深度学习层是人工神经网络(ANN)节点,其运作方式与人脑神经元类似。节点可以是硬件和软件的组合。深度学习算法中的每一层都由ANN节点组成。每个节点或人工神经元都连接到另一个节点,并具有关联的值号和阈值号。节点在激活时将其值号作为输入发送到下一层节点。仅当其输出高于指定阈值时才会激活。否则,不会传递任何数据。

对比GOFAI,机器学习从推理变成了归纳,寻找输入和输出间的关系,然后再泛化以处理新问题。

上一个AI热潮有两个明星领域——人脸识别和推荐算法,都是深度学习的产物。

过去十年间,深度学习理论和实践持续进步,最终推动了ChatGPT的诞生:

无监督学习(Unsupervised Learning):训练数据不再需要人工打标,大大减少了数据准备工作。

Transformer 模型:2017年出现,通过并行处理大大降低了训练难度。

人类反馈强化学习(Reinforcement Learning from Human Feedback):保持输出与预期一致,这点对LLM的应用成熟至关重要。

上述技术在2018年组合到一起,开启了本轮AI热潮的scaling law,从2018年1.1亿参数的GPT,到2021年1750亿参数的GPT-3,再到1.8万亿参数的GPT-4。

大模型就像个压缩算法,参数的不断增加,可以让大模型存储更多的知识,能回答更宽泛的问题。但和其他机器学习算法一样,它仍然是在通过归纳的方式寻找输入和输出间的逻辑关系,也就是说,它不是在回答正确的答案,而是在回答最像正确答案的答案,这就是其幻觉(hallucination)产生的原因。

对LLM的使用有几个层次:

最简单的是直接使用基础模型,例如直接在www.chatgpt.com网页上和GPT-4对话,或者直接调用Llama的API。

指令工程(Prompt Engineer):类似ChatGPT提供的GPTs功能,通过指令条件,让LLM扮演某个角色,或向其提供上下文,提高其在特定场景下的表现能力。

检索增强生成(Retrieval Augmented Generation):总有模型训练时未采用的数据,特别是组织内部或者个人数据。数据的缺失是模型回答幻觉的重要原因,使用RAG可以将私有信息存入向量数据库,根据问题查询相关信息,将搜索结果一并加入prompt提交给模型作为输入,可以大大提高模型对特定问题的准确度。

微调模型(Fine-Tuning):RAG可以给模型新知识,但有些场景需要的不只是新知识,而是新能力,例如编写代码、总结文章、撰写邮件等。这时就可以用Low-Rank Adaptation(LoRA)等方法对基础模型进行微调,提高其在特定场景的能力。

综上所述,至少大语言模型LLM不会成为神,即使scaling law依旧有效,LLM接下来拥有更多的参数、更多的知识,在更多的领域比人类强,也不会变成AGI。相反,与传统的指令性代码不同,深度学习和神经网络提供的是一种新的计算机,在某些领域能提供传统计算机无法达成的价值,例如特斯拉FSDV12版本对之前版本的碾压式进步。

苹果在过去的WWDC上选择的Apple Intelligence路线也是将LLM模型当成了电,哪个应用需要就接进去,根据需求不同还能提供不同的“电压”。关于微软、Alphabet和苹果等大厂的AI战略,我们留待下篇再聊。